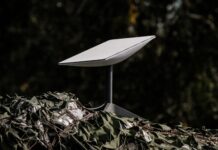

Trong hơn hai thập niên qua, chiến tranh đã thay đổi sâu sắc. Từ những cuộc không kích bằng máy bay có người lái, quân đội Hoa Kỳ đã chuyển sang sử dụng drone – vũ khí cho phép tấn công từ xa với độ chính xác cao hơn và ít rủi ro hơn cho binh sĩ. Nhưng giờ đây, một bước chuyển mới đang diễn ra: từ drone có người điều khiển sang hệ thống AI có khả năng tự động hóa quyết định trên chiến trường.

Và chính tại điểm giao này, Quốc hội Mỹ bắt đầu nhận ra: nếu không đặt giới hạn ngay từ bây giờ, cán cân giữa công nghệ và đạo đức có thể vượt khỏi tầm kiểm soát.

Drone: bước đầu của “chiến tranh từ xa”

Sau sự kiện September 11 attacks, Mỹ đẩy mạnh sử dụng drone trong các chiến dịch chống khủng bố.

Các dòng UAV như MQ-9 Reaper cho phép:

- theo dõi mục tiêu trong nhiều giờ

- tấn công chính xác bằng tên lửa Hellfire

- giảm thiểu rủi ro cho binh sĩ Mỹ.

Tuy nhiên, drone vẫn giữ một nguyên tắc quan trọng:

👉 con người là người ra quyết định cuối cùng.

AI bước vào chiến trường

Sự xuất hiện của AI đã thay đổi hoàn toàn cấu trúc này.

Trong các chương trình như Project Maven, AI được sử dụng để:

- phân tích hình ảnh từ drone

- xác định mục tiêu tiềm năng

- đề xuất hành động.

Ban đầu, AI chỉ đóng vai trò hỗ trợ. Nhưng khi công nghệ tiến bộ, ranh giới bắt đầu mờ đi:

👉 AI không chỉ đề xuất — mà có thể ảnh hưởng trực tiếp đến quyết định tấn công.

Ranh giới nguy hiểm: “human in the loop” có còn thật?

Pentagon luôn khẳng định nguyên tắc:

- “human in the loop” (con người trong vòng kiểm soát)

Nhưng trong thực tế:

- tốc độ chiến trường ngày càng nhanh

- lượng dữ liệu quá lớn

- áp lực phản ứng tức thì.

Điều này dẫn đến một thực tế đáng lo:

👉 con người có thể chỉ còn đóng vai trò phê duyệt mang tính hình thức.

AI sát thương: bước nhảy nguy hiểm nhất

Nếu AI được phép:

- tự xác định mục tiêu

- tự quyết định tấn công

thì chiến tranh sẽ bước sang một giai đoạn hoàn toàn mới:

👉 máy móc đưa ra quyết định sống – chết.

Đây là lý do xuất hiện khái niệm:

- “lethal autonomous weapons” (vũ khí tự hành sát thương)

Một khi hệ thống này được triển khai rộng rãi:

- tốc độ chiến tranh sẽ vượt quá khả năng kiểm soát của con người

- nguy cơ sai sót hoặc leo thang ngoài ý muốn tăng mạnh.

Vì sao Quốc hội phải vào cuộc

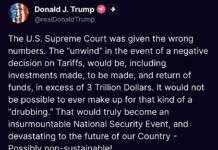

Các hướng dẫn nội bộ của U.S. Department of Defense hiện nay chỉ mang tính chính sách, không phải luật.

Điều đó có nghĩa:

- chúng có thể bị thay đổi

- hoặc bị nới lỏng trong thời chiến.

Dự luật mới nhằm:

- cấm AI tự quyết định tiêu diệt mục tiêu

- cấm giám sát diện rộng trong nước

- cấm AI liên quan đến vũ khí hạt nhân.

Nói cách khác, Quốc hội đang cố:

👉 đóng khung những giới hạn không thể vượt qua.

Xung đột với các công ty AI

Sự can thiệp của Quốc hội cũng phản ánh một căng thẳng mới giữa chính phủ và các công ty công nghệ.

Một số công ty AI, như Anthropic, đã:

- từ chối cho phép công nghệ của mình dùng cho mục đích quân sự nhất định

- nhấn mạnh các nguyên tắc an toàn.

Trong khi đó, Pentagon xem AI là:

👉 lợi thế chiến lược trong cạnh tranh toàn cầu.

Sự khác biệt này tạo ra một câu hỏi lớn:

Ai sẽ quyết định giới hạn của AI – chính phủ hay các nhà phát triển?

Hạt nhân: ranh giới cuối cùng

Phần đáng chú ý nhất của dự luật là:

👉 cấm AI tham gia vào việc phóng hoặc kích nổ vũ khí hạt nhân.

Hiện nay, hệ thống hạt nhân của Mỹ vẫn dựa trên:

- quyết định của con người

- chuỗi chỉ huy chặt chẽ.

Nếu AI được đưa vào hệ thống này, rủi ro sẽ tăng theo cấp số nhân:

- lỗi thuật toán

- dữ liệu sai

- hoặc hiểu nhầm tín hiệu.

Đây là lý do nhiều chuyên gia coi đây là:

👉 lằn ranh đỏ không thể vượt qua.

Cuộc đua AI toàn cầu

Một yếu tố khác khiến vấn đề trở nên cấp bách là:

- Trung Quốc

- Nga

- và các quốc gia khác

đều đang phát triển AI quân sự.

Điều này tạo ra một nghịch lý:

- nếu Mỹ hạn chế AI quá mức → có thể mất lợi thế

- nếu không hạn chế → rủi ro đạo đức và an ninh tăng cao.

Kết luận: luật hay là quá muộn

Dự luật mà Quốc hội đang xem xét không phải là câu trả lời cuối cùng.

Nhưng nó là dấu hiệu cho thấy:

👉 Washington đã nhận ra một thực tế mới.

AI không còn là công cụ trung lập.

Nó đã trở thành yếu tố quyết định trong chiến tranh hiện đại.

Và câu hỏi không còn là:

có nên dùng AI trong chiến tranh hay không

mà là:

giới hạn của AI trong chiến tranh sẽ được đặt ở đâu – và bởi ai.

Kết luận

Khi drone xuất hiện, con người vẫn giữ quyền quyết định bóp cò. Nhưng với AI, quyền đó đang dần bị chuyển giao cho thuật toán. Dự luật của Quốc hội Mỹ không chỉ là một văn bản pháp lý, mà là nỗ lực cuối cùng để giữ lại một nguyên tắc tưởng chừng hiển nhiên: con người phải chịu trách nhiệm cho cái chết mà mình gây ra.

Nếu nguyên tắc đó bị xóa bỏ, chiến tranh sẽ không chỉ nhanh hơn – mà còn nguy hiểm hơn theo cách mà chúng ta chưa từng trải qua.